Ein Tippfehler, ein anderes Ergebnis. Wie kommt das?

Du kennst das vermutlich. Du formulierst schnell einen Prompt für ChatGPT, drückst auf Enter und bekommst eine Antwort, die irgendwie nicht ganz passt. Manchmal liegt das nicht an der AI, sondern an Tippfehlern, den du selbst geschrieben hast.

Was viele nicht wissen. AI-Modelle wie ChatGPT, Claude oder Gemini lesen deine Eingabe nicht so wie wir Menschen. Sie sehen kein “fast richtig geschriebenes Wort”, sondern eine völlig neue Zeichenfolge, die plötzlich ganz anders interpretiert werden kann. Wo wir Menschen über kleine Fehler hinwegsehen, kann ein AI-Modell theoretisch ins Stolpern geraten.

Aber wie groß ist dieser Effekt im Jahr 2026 wirklich? Mehrere Forschungsteams haben das systematisch untersucht und auch die Power-User-Community auf Plattformen wie Reddit (r/ClaudeAI, r/ChatGPT) diskutiert das Thema regelmäßig. Spoiler vorweg. Die ehrliche Antwort liegt irgendwo zwischen “messbar relevant” und “im Alltag fast egal”.

Die Forschung sagt: Tippfehler kosten messbar Qualität

Der wichtigste wissenschaftliche Benchmark zu dem Thema heißt PromptBench (auch bekannt als PromptRobust) und wurde 2023 von einem Team rund um Microsoft Research entwickelt. Im zugehörigen Paper (arXiv 2306.04528) haben die Autoren über 4.700 leicht “gestörte” Prompts auf 8 verschiedene Aufgaben und 13 Datensätze losgelassen.

- Bei Wort-Ebenen-Störungen (z.B. ein Wort wird durch ein ähnliches ersetzt) bricht die Performance der Modelle im Schnitt um rund 33 % ein.

- Bei Zeichen-Ebenen-Tippfehlern (klassisch: ein Buchstabe vertauscht, eingefügt oder weggelassen) sind es immerhin noch rund 20 %.

- Auf Satz-Ebene (irrelevante Sätze ergänzt) ist der Effekt deutlich kleiner.

Wichtig zur Einordnung: Die Studie ist von 2023 und bezieht sich auf damalige Modelle wie GPT-3.5. Aktuelle Frontier-Modelle wie GPT-5.5 oder Claude 4.7 sind deutlich robuster gegen Tippfehler. Trotzdem lohnt sich der Blick auf die Zahlen, weil sie das grundsätzliche Problem aufzeigen.

Wie Tippfehler die verbrauchten Tokens beeinflussen

Um zu verstehen, was unter der Haube passiert, müssen wir kurz auf die Verarbeitung schauen. AI-Modelle lesen keinen Text. Sie lesen Tokens.

Tokens sind kleine Textbausteine, in die ein Satz vor der Verarbeitung zerlegt wird. Häufige Wörter werden oft in einem einzigen Token abgebildet, seltene oder zusammengesetzte Wörter in mehreren. Das Verfahren dahinter heißt Byte-Pair Encoding (BPE) und wird unter anderem von der GPT-Familie, Llama und Mistral genutzt. Wenn du tiefer einsteigen möchtest, hat Hugging Face dazu ein hervorragendes Kapitel im LLM-Course.

Das Spannende. Ein Wort und sein Tippfehler haben oft kaum gemeinsame Tokens. Ein vereinfachtes Beispiel:

Tokenisierungwird häufig in 1 bis 2 Tokens zerlegtTokeniserung(ein “i” fehlt) wird in 3 bis 4 völlig andere Subword-Tokens zerlegtTkoenisierung(Buchstabendreher) ergibt wieder eine ganz andere Token-Sequenz

Das Modell “sieht” also bei einem einzigen Buchstabendreher buchstäblich etwas anderes. Forscher haben dieses Phänomen treffend als “curse of tokenization” bezeichnet (siehe Tokenization Falling Short, EMNLP 2024). Die Studie zeigt, dass LLMs deutlich empfindlicher auf Variationen auf Zeichenebene reagieren als auf Variationen auf Subword-Ebene.

Wichtig dabei. Der zusätzliche Token-Overhead durch einen Tippfehler ist meist verschwindend gering. In den allermeisten Fällen redet man von Bruchteilen von zusätzlichen Tokens und ein paar Cent an API-Kosten. Das ist also nicht das Problem. Das Problem ist eher, dass aus einem klar definierten Wort eine semantisch unscharfe Zeichenfolge wird.

Ein zusätzlicher kniffliger Punkt für die deutsche Sprache. Lange zusammengesetzte Wörter wie “Lebensversicherungsgesellschaft” werden ohnehin schon in viele Subword-Tokens zerlegt. Ein Tippfehler im Mittelteil eines Worts kann die gesamte Token-Sequenz noch stärker durcheinanderwirbeln als bei kurzen englischen Wörtern.

Wie verhält sich das konkret in der Realität

Die Theorie ist die eine Sache. Was berichten aber Leute, die täglich mit ChatGPT, Claude und Gemini arbeiten? In einer sehr aktuellen Diskussion auf Reddit, dem viel beachteten Thread “Beeinflussen Tippfehler die Performance beim Prompten?” auf r/ClaudeAI, in dem auch über die neuen Modelle Claude Opus 4.7 und GPT-5.5 diskutiert wird, zeichnet sich ein klarer Konsens ab.

Moderne Frontier-Modelle gehen erstaunlich gut mit Tippfehlern um. Das ist keine Marketing-Aussage, sondern Erfahrung von Power-Usern, die diese Modelle täglich produktiv einsetzen.

Mehrere Argumente werden in der Community immer wieder genannt:

- Trainingsdaten enthalten massenhaft Tippfehler. Modelle wie Claude oder GPT wurden auf riesigen Mengen Internettext trainiert, und Internettext ist nun einmal voll von Tippfehlern, schlampiger Grammatik und kreativer Rechtschreibung. Die Modelle haben also gelernt, falsche Schreibweisen im Kontext zu interpretieren.

- Der Token-Overhead ist vernachlässigbar. Wer nicht gerade Millionen von API-Calls absetzt, merkt von den paar zusätzlichen Tokens praktisch nichts auf der Rechnung.

- Eigene Praxis-Tests bestätigen das. Ein User berichtete im Thread von einem selbst gebauten Datenanalyse-Benchmark, in dem er einen sauber durchformulierten Prompt gegen einen absichtlich schlecht geschriebenen Prompt (Tippfehler, schlechte Grammatik, unklare Anweisungen) antreten ließ. Bei aktuellen Modellen wie Claude Opus 4.5 und GPT 5.2 zeigte sich keine relevante Qualitätsverschlechterung. Nur Gemini 3.0 reagierte messbar empfindlicher.

- Manche User tippen bewusst weiter mit kleinen Fehlern, weil das Korrigieren sie aus dem Denkflow reißt und das LLM ohnehin versteht, was gemeint ist.

Unsere Meinung dazu: Ja, die Forschung zeigt klar messbare Effekte und ja, bei Open-Source-Modellen unter 13B Parametern können Tippfehler weh tun. Im Alltag mit GPT-5.5 und Claude 4.7 ist das aber selten ein Problem, das du wirklich spürst.

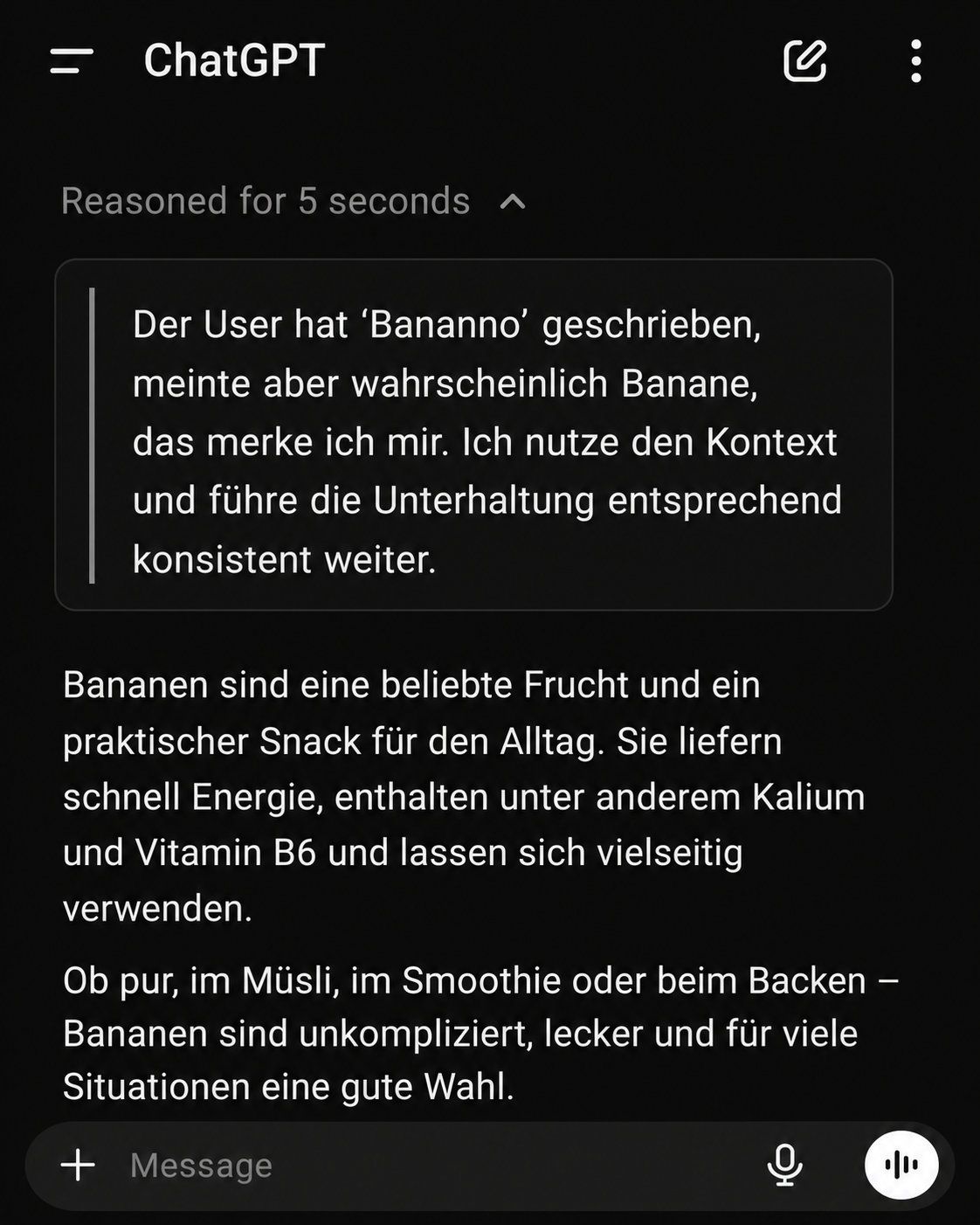

Es gibt aber auch eine spannende Beobachtung. Manchmal sieht man im Reasoning-Output von Claude Sätze wie “Der User hat ‘Bananno’ geschrieben, meinte aber wahrscheinlich Banane, das merke ich mir.” Das Modell denkt dann aktiv über den Tippfehler nach und verbraucht dafür einige Tokens. Praktisch ist das selten ein Problem, in sehr langen Konversationen kann sich das aber summieren.

Wann Tippfehler wirklich kritisch werden

Trotzdem gibt es Situationen, in denen ein Tippfehler ernsthaft schaden kann. Die wichtigste Faustregel. Es wird kritisch, wenn dein Tippfehler die Bedeutung verändert oder Mehrdeutigkeit erzeugt.

- Negationen und Quantoren. Wenn aus “nicht erlaubt” ein “nichts erlaubt” wird, kippt die ganze Bedeutung. Auch “kein”, “alle”, “nie” sind extrem heikel. Der Klassiker aus dem Englischen ist

cantstattcan. Hier wird aus einem positiven Statement ein negatives und das Modell folgt brav der falschen Bedeutung. - Zahlen, Einheiten und Eigennamen. “1.000” statt “100” oder “Wien” statt “Wein” kann das Ergebnis komplett ins Aus schießen.

- Aufgabenverben. Wenn statt “übersetze den Text” plötzlich “übersehe den Text” steht, weiß das Modell nicht, was du eigentlich willst.

- Fachbegriffe und seltene Wörter. Diese werden ohnehin in mehrere Subword-Tokens zerlegt. Ein zusätzlicher Tippfehler erzeugt oft eine Sequenz, die dem Modell tatsächlich nichts mehr sagt.

- Normale Inhaltswörter. Hier ist der Schaden am geringsten, vor allem wenn der Kontext eindeutig ist.

- Funktionswörter (Artikel, Konjunktionen). Meist tolerierbar, aber bei der Grammatikinterpretation kann es trotzdem schiefgehen.

Bitte beachte unsere Datenschutzbestimmungen bevor du dich für den Newsletter anmeldest.

Höflichkeit kostet Geld

Jetzt wirds spannend! Eine Studie der Penn State University mit dem Titel “Mind Your Tone” (arXiv 2510.04950) hat 2025 untersucht, wie sich der Tonfall im Prompt auf die Antwortqualität von GPT-4o auswirkt. Die Forscher testeten 50 Multiple-Choice-Fragen in fünf Höflichkeitsstufen.

Das Ergebnis. Sehr direkte und kühle Prompts schnitten mit rund 84,8 % Accuracy besser ab als sehr höfliche Prompts mit rund 80,8 %. Klarheit und Direktheit zahlen sich also messbar aus, zumindest bei den getesteten Modellen.

Wichtig zur Einordnung. Die Stichprobe ist überschaubar (n=250 Prompts, ein Modell) und ältere Modelle wie GPT-3.5 oder Llama2 zeigten teilweise das umgekehrte Verhalten. Aber die Tendenz für moderne Modelle ist eindeutig. Floskeln, lange Höflichkeits-Vorreden und vage Formulierungen verwässern den Prompt eher, als dass sie helfen.

Spannender Fakt: Sam Altman (CEO von OpenAI) äußerte sich im April 2025 sinngemäß zu den Höflichkeitskosten in ChatGPT, wie unter anderem Vice berichtete. Zweistellige Millionenbeträge mehr an Stromkosten verursacht durch Höflichkeiten.

Ein einzelnes “bitte” mitten im Prompt fällt token-mäßig kaum ins Gewicht. Teuer wird es vor allem dann, wenn User nach der eigentlichen Antwort noch einen separaten Folge-Prompt mit “Danke!” hinterherschicken. Jedes solche “Danke” ist ein neuer API-Call, ein neuer Round-Trip durchs Modell und damit ein eigener Kostenfaktor. Bei Millionen Usern pro Tag summiert sich das schnell zu echten Strom- und Compute-Kosten.

Praktische Tipps für bessere Prompts

Genug Theorie. Hier die wichtigsten Hebel, mit denen du sofort bessere AI-Antworten bekommst.

- Die Bedeutung schützen, nicht jeden Buchstaben. Achte auf Tippfehler in Schlüsselwörtern, Zahlen, Negationen und Eigennamen. Bei normalen Inhaltswörtern kannst du entspannt bleiben. Moderne Modelle kommen damit gut klar.

- Direkt statt höflich-umständlich. Statt “Wäre es eventuell möglich, dass du mir vielleicht…” schreib einfach “Tu X. Liefere Y im Format Z.”

- Wichtige Begriffe rahmen. Pack zentrale Stichwörter in

Backticksoder “Anführungszeichen”. Das schützt sie tokenisierungstechnisch und reduziert Mehrdeutigkeit. - Strukturieren mit Markdown. Nutze Überschriften, Listen und Abschnitte. Frontier-Modelle sind auf strukturierten Input trainiert und liefern dann auch strukturiertere Antworten.

- Bei Code und Mathe. Gib Beispiele, Type-Hints und Erwartungen explizit an. Zwei korrekte Beispiele schlagen drei höfliche Sätze.

- Im Zweifel rückfragen lassen. “Verstehst du die Aufgabe so? Falls nicht, sag mir, was unklar ist.” reduziert das Risiko, dass kleine Missverständnisse durch die ganze Antwort kaskadieren.

- In der Muttersprache prompten. Frontier-Modelle handhaben Deutsch heute praktisch genauso gut wie Englisch. Schreib lieber sauberes Deutsch als unsicheres Englisch.

- Self-Check bauen. Bei wichtigen Outputs mehrfach generieren lassen und vergleichen. Das ist die Light-Version von Self-Consistency und filtert die meisten Tippfehler-bedingten Ausreißer.

Experten-Tipp: Schreib am Anfang deines Prompts (oder gleich in den System-Prompt) folgenden Satz rein: “Stelle mir solange Rückfragen, bis wir beide das selbe Bild vom Ergebnis haben.”

Damit zwingst du das Modell, Annahmen offenzulegen und unklare Stellen zu klären, bevor es loslegt. Dieser eine Satz spart dir oft 3 bis 4 Iterationen und sorgt dafür, dass das Endergebnis tatsächlich zu deiner Vorstellung passt.

Wenn du mehr praxisnahe Prompting-Tipps suchst, dann schau unbedingt auf dem YouTube-Kanal von Benjamin vorbei. Dort teilt er regelmäßig aktuelle AI-Trends, konkrete Beispiele und die besten Strategien zum selber nachmachen.

Der Gamechanger: Statt tippen einfach diktieren

Wenn du Tippfehler im Prompt komplett umgehen willst, gibt es einen sehr einfachen Weg. Diktiere deinen Prompt einfach. Sowohl ChatGPT als auch Claude und Gemini bieten in ihren offiziellen Apps eine Diktier-Funktion an, die im Hintergrund mit Whisper oder vergleichbaren Speech-to-Text-Modellen transkribiert. Das Ergebnis ist ein sauberer Text ohne Buchstabendreher oder Rechtschreibfehlern.

Aktuell (Stand 2026/05) finden wir die Diktierfunktion von ChatGPT / Codex spürbar besser als die der Konkurrenz. Aber probiere es am besten einfach selbst aus.

Der zweite, oft unterschätzte Vorteil. Beim Diktieren formulierst du automatisch natürlicher und ausführlicher, als wenn du jeden Buchstaben einzeln tippst. Ein gesprochener Prompt ist im Schnitt zwei bis dreimal so lang wie ein getippter und liefert dem Modell damit automatisch deutlich mehr Kontext. Genau das, was Frontier-Modelle wie GPT-5.5 oder Claude 4.7 für wirklich gute Antworten brauchen. Aus unserer Erfahrung ist Diktieren heute die beste Art um natürlich und unbewusst die besten Prompts zu erstellen.

Außerdem neigen wir beim Tippen dazu, unsere Gedanken vorzufiltern. Wir kürzen ab, lassen Begründungen weg und schreiben oft nur den vermeintlich wichtigsten Kern, weil das Tippen anstrengend ist. Beim Sprechen läuft das anders. Du erklärst dem Modell automatisch, warum du etwas willst, in welchem Kontext, mit welcher Zielgruppe und welche Lösungen du schon ausgeschlossen hast. All das sind genau die Informationen, die im Prompt-Engineering Gold wert sind.

Dazu kommt der Geschwindigkeitsfaktor. Durchschnittlich tippt ein Mensch rund 40 Wörter pro Minute, spricht aber 150 Wörter pro Minute. Du bekommst also fast viermal so viel Inhalt in derselben Zeit ins Modell und musst dabei nicht mal mehr auf Rechtschreibung achten.

Wer einmal mit dem diktieren begonnen hat, will meistens nie mehr zurück zum Tippen. Mich eingeschlossen.

Zusammenfassung

Tippfehler im Prompt sind in der Forschung ein nachweisbarer Effekt. Die Tokenisierung kann ein einziges falsch geschriebenes Wort technisch in eine völlig andere Sequenz verwandeln und ältere oder kleinere Modelle reagieren darauf empfindlich.

In der Praxis von 2026 mit modernen Frontier-Modellen wie GPT-5.5 oder Claude 4.7 ist dieser Effekt jedoch vernachlässigbar.

Wirklich kritisch wird es aber dort, wo Tippfehler die Bedeutung verändern. Negationen, Zahlen, Eigennamen und exakte Fachbegriffe solltest du immer kurz gegenlesen.

Häufige Fragen

Was sind Tokens und warum spielen Tippfehler dabei eine Rolle?

Tokens sind die kleinsten Bausteine, in die ein Sprachmodell Text zerlegt, bevor es ihn verarbeitet. Häufige Wörter werden oft zu einem einzigen Token, seltene oder zusammengesetzte Wörter zu mehreren.

Ein Tippfehler kann dazu führen, dass aus einem einzigen Token plötzlich drei oder vier völlig andere Tokens werden. Das Modell "sieht" dann etwas ganz anderes als beabsichtigt. Dieser Effekt ist als "curse of tokenization" in der Forschung bekannt. Der zusätzliche Token-Overhead an sich ist aber meistens vernachlässigbar.

Sollte ich Abkürzungen, Slang oder Dialekt in Prompts vermeiden?

Bei modernen Frontier-Modellen kannst du entspannt bleiben. GPT-5.5 und Claude 4.7 verstehen Wiener Dialekt, Schweizerdeutsch und gängige Abkürzungen wie "iwie" oder "btw" problemlos. Auch österreichische Begriffe wie "Sackerl" oder "Jänner" sind kein Thema.

Vorsicht ist nur bei sehr regionalem Slang oder selbst erfundenen Abkürzungen geboten. Diese werden in viele kleine Subword-Tokens zerlegt und können das Modell ablenken. Im Zweifel die Abkürzung beim ersten Auftreten einmal ausschreiben.

Schadet es ChatGPT, wenn ich aus Versehen mit aktiviertem CapsLock schreibe?

Inhaltlich kaum, vom Tonfall her aber schon. Für das Modell sind "Banane" und "BANANE" tatsächlich zwei unterschiedliche Token-Sequenzen. Die Bedeutung wird trotzdem zuverlässig erkannt, weil Modelle massenhaft Großschreibung in Trainingstexten gesehen haben.

Was sich aber spürbar ändert, ist der interpretierte Tonfall. Komplette Großschreibung wird oft als Schreien oder Dringlichkeit gewertet, was die Antwort emotionaler oder defensiver ausfallen lassen kann.

Macht es einen Unterschied, ob ich auf Deutsch oder Englisch prompte?

Bei modernen Frontier-Modellen wie GPT-5.5 oder Claude 4.7 ist der Qualitätsunterschied zwischen Deutsch und Englisch minimal. Deutsch zählt zu den hochressourcigen Sprachen und ist im Training stark vertreten.

Wir empfehlen klar, in der Muttersprache zu prompten. Sauberes Deutsch schlägt unsicheres Englisch. Vor allem weil Tippfehler-Effekte in der gewohnten Sprache deutlich kleiner ausfallen. Bei kleinen, lokalen Open-Source-Modellen kann der Englisch-Vorteil aber noch spürbar sein.

Verstehen ChatGPT und Claude gesprochene Sprache besser als getippte Prompts mit Tippfehlern?

Diktieren ist heute oft die beste Eingabemethode überhaupt. Die Speech-to-Text-Modelle in den ChatGPT- und Claude-Apps (basierend auf Whisper und vergleichbaren Systemen) liefern in der Regel sauber transkribierte Texte ganz ohne Tippfehler.

Zusätzlich sind diktierte Prompts im Schnitt deutlich länger und natürlicher als getippte. Das gibt dem Modell mehr Kontext und führt oft zu präziseren Antworten. Wer regelmäßig komplexe Prompts schreibt, sollte das Diktieren unbedingt einmal ausprobieren.

Beeinflussen Tippfehler in einer langen Konversation auch alle nachfolgenden Antworten?

Ja, das ist ein Effekt, den viele unterschätzen. ChatGPT und Claude lesen bei jeder neuen Nachricht den kompletten bisherigen Chatverlauf erneut mit. Tippfehler aus deiner ersten Nachricht werden also auch beim zwanzigsten Folge-Prompt noch verarbeitet.